作家先容

Hao Yu,携程资深大数据平台开发工程师,温暖实时筹谋、湖仓和大数据散播式筹谋等范围。

目次

一、媒介

二、架构设想

三、应用实践

四、完了回来

五、畴昔筹谋

跟着携程业务的快速大师化扩张,携程传统 T+1 数据时效的离线数仓已无法满足日益增长的准实时辰析决策需求。为治理 Lambda 架构下开发运维本钱崇高、链路割裂、时效性不及等核肉痛点,咱们设想并实践了一套以 Flink CDC 与 Apache Paimon 为中枢的近实时湖仓一体化治理有辩论。

本文发轫答复了该有辩论的全体架构设想,重心先容了为满足坐褥环境禁止而构建的两阶段 CDC 数据入湖机制,并详备答复了如何通过性能优化、动态更新和引擎阅兵等一系列实践,攻克了坐褥环境中的关节挑战。最终,通过在国际化营销、告白归因等场景的应用,有辩论完了了端到端分钟级延迟,考证了其在降本增效和驱动业务敏捷决策上的权臣价值。

一、媒介:从 T+1 到分钟级,数据灵验性的挑战和机遇

携程原稀有据体系已构建了锻练的离线批处理链路,省略复古大部分 T+1(天级)或 T+1H(小时级)的数据分析场景。但是,跟着业务的抓续增长与精粹化运营的需求,数据簇新度与筹谋本钱之间的矛盾日益突显。

传统离线数仓:虽具备锻练生态与本钱上风,但其中枢瓶颈在于时效性低。

纯实时筹谋:虽能完了秒级延迟,但在处理大范畴数据时,面对景况治理本钱崇高、音信中间件存储支出遍及等问题,导致总本钱权臣加多。

Lambda 架构:因实时与离线链路物理割裂,在面对会通分析需求时,时常需要双团队协同开发,波及多半数据口径对都责任,变成崇高的东说念主力协调本钱,蹂躏了业务敏捷反应。

为应酬上述挑战,业务亟需一个低门槛、低本钱、端到端具备分钟级延迟(标的 5-30 分钟)的流批一体数据治理有辩论。该有辩论旨在和洽数据处理链路,权臣进步端到端时效性,同期驳倒开发、运维职守与总体运行本钱。为此,咱们聘任了 Flink + Paimon 的工夫栈,并设想了一套改造的数据入湖架构来治理数据同步与数据应用,旨在从根源上治理这些挑战。

二、 架构设想:构建基于 Flink 和 Paimon 的近实时湖仓

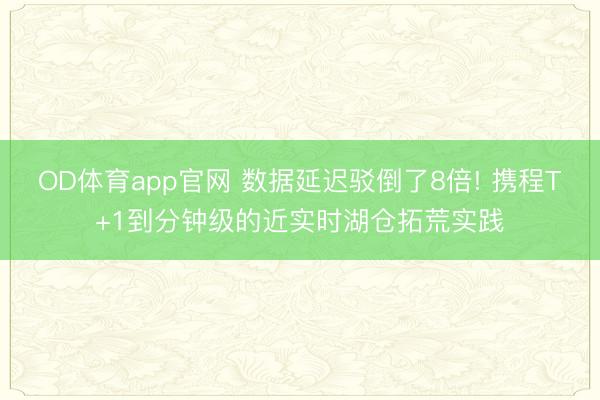

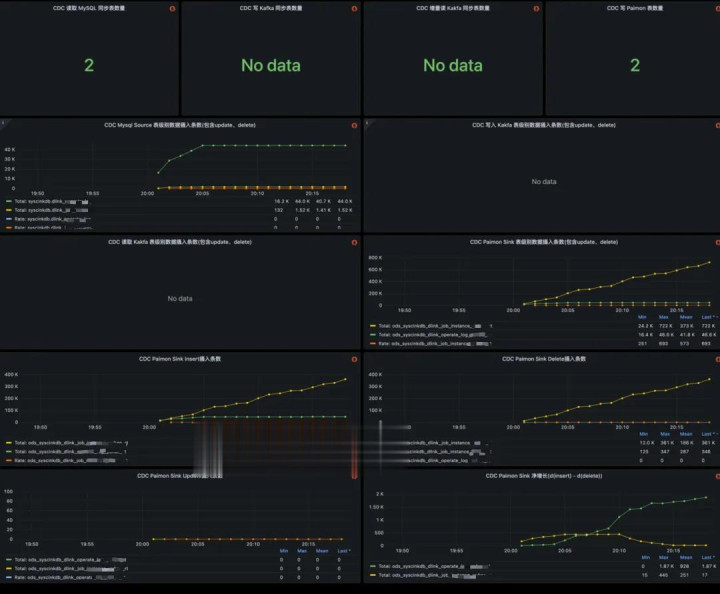

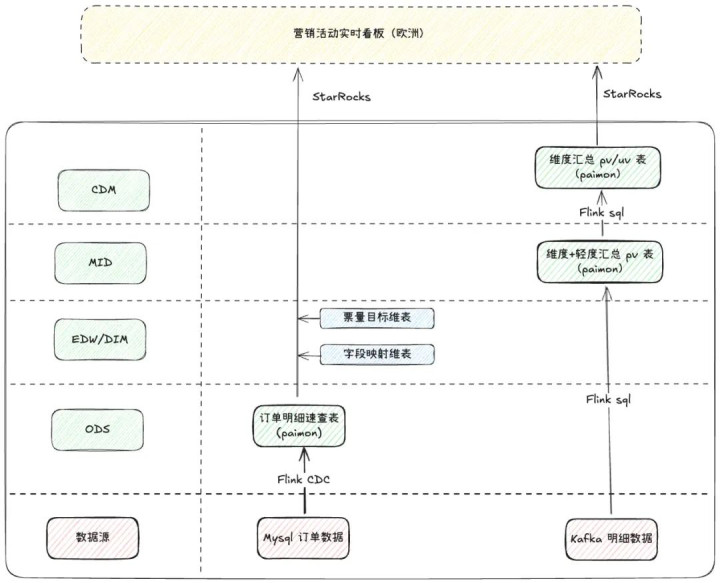

1、近实时系统架构

为完了上述标的,咱们构建了如图 1 所示的近实时数据处理架构。该架构以 Flink四肢中枢筹谋引擎, Paimon 四肢湖仓存储底座。数据通过 Flink CDC 从 MySQL 等业务数据库拿获变更数据流,实时写入 ODS 层的 Paimon 表中。卑劣应用可凭据需求,聘任多种消费与分析旅途:

实时/准实时 ETL:通过 Flink 功课抓续消费上游 Paimon 表的增量数据,进行实时流式处理。

高速 OLAP 查询:将筹谋完了牺牲或平直接入 StarRocks,满足高性能、交互式的分析查询需求。

纯果然 Ad-hoc 查询与离线分析:借助 Trino 或 Apache Spark 引擎,对湖内数据进行纯果然即席查询与大范畴批处理分析。

通过该架构,咱们为不同行务方提供了和洽、千般的近实时数据管事,完了了筹谋与存储的高效协同。

图 1:系统架构图

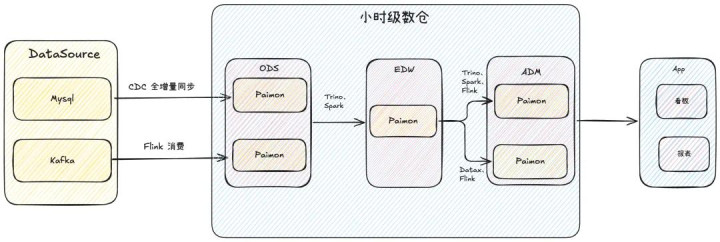

2、ODS 层数据入湖

在工夫选型上,咱们聘任 Paimon 四肢中枢存储底座,主要基于其与 Flink 生态的深度原生集成、纯果然 Merge Engine 机制(如 partial-update、aggregation)以及 LSM 树结构的存储模子。比较 Hudi 或 Iceberg,Paimon 在咱们的 Upsert 密集型场景中展现了更优的写入性能和更低的证实本钱,有劲复古了近实时湖仓的构建。

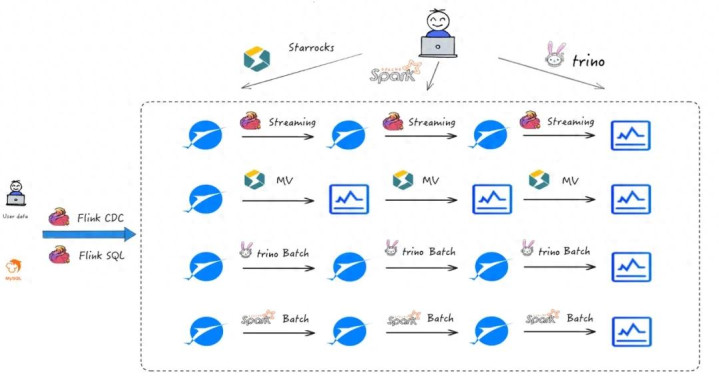

1)两阶段 CDC 入湖架构设想

携程多半业务数据存储于 MySQL 中,其线上部署遵命 master-slave-slavedr 模式。为了保险线上数据库的贯通性,咱们对同步任务有一些戒指策略:

读取节点戒指:数据同步任务只可从 Slave 节点读取数据。

Binlog 读取戒指:每个 MySQL 物理实例(Instance)仅允许一个线程读取其 binlog,以幸免并发读取对 binlog 存档产生侵略。

连合数戒指:单个账户对数据库的最大连合数受限(不跳动 40)。

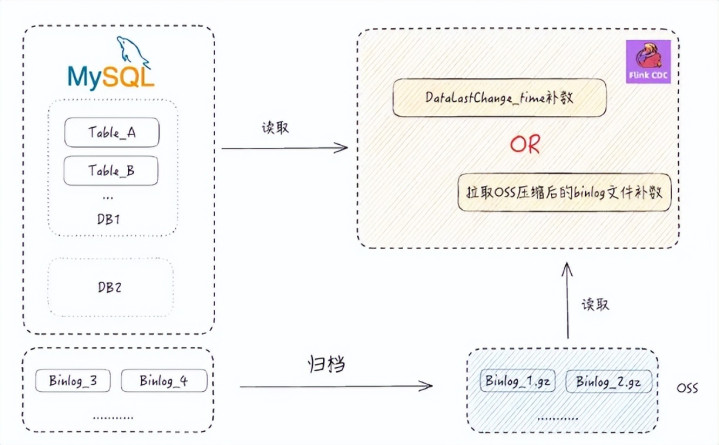

上述单实例单线程读取 binlog 的禁止,是催生咱们设想“分享 Source,独处 Sink”两阶段 CDC 架构的根蒂原因。若为每个用户的同步任务单独启动一个齐备的 CDC 功课,将占用实例的惟一 binlog 读取进度。因此,咱们设想的 CDC 同步过程(如图 2 所示)分为两个独处的阶段:

图 2:cdc 同步过程图

咱们将 CDC 同步 Flink 任务主要分为两大类:

第一阶段(source 任务):由平台和洽治理的分享 Flink 功课。该任务看重从指定 MySQL 实例读取 binlog,并将增量数据分发至 Kafka。此任务对粗俗用户透明且弗成操作,确保了对中枢 DB 资源的合规、高效复用。

第二阶段(sink 任务):由用户自行治理的 Flink 功课。该任务从 Kafka 消费数据,并写入标的 Paimon 表。用户可对此任务进行启停、竖立等操作。

该架构支抓单库单表、单库分表、分库分表等多种同步模式,并通过平台化的治理,完了了对复杂 DB 环境的灵验适配。Sink 任务支抓多种运行模式:

全量+增量一体化模式:初次启动时,功课自动履行全量数据快照同步,完成后无缝切换至 Kafka 的指定位点,出手消费增量数据。

纯增量模式:仅对增量数据感兴趣兴趣的场景,功课平直从 Kafka 消费。

数据回补模式:用于很是收复,推行是带过滤要求的全量+增量一体化同步。

2) 坐褥实践优化与挑战

①同步链路性能优化

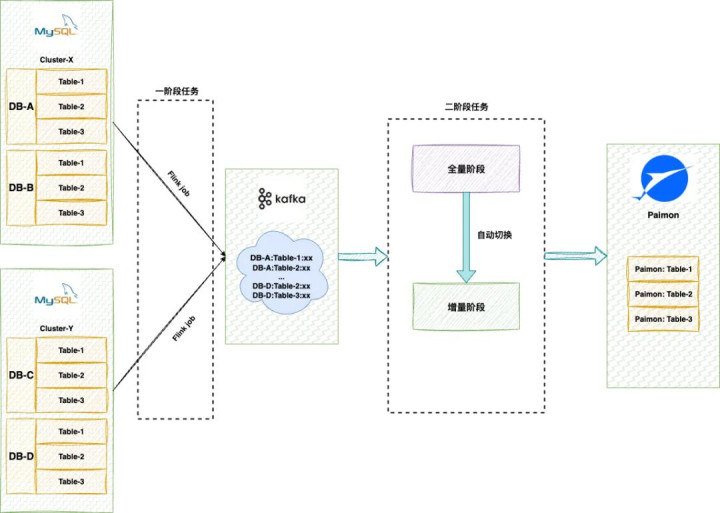

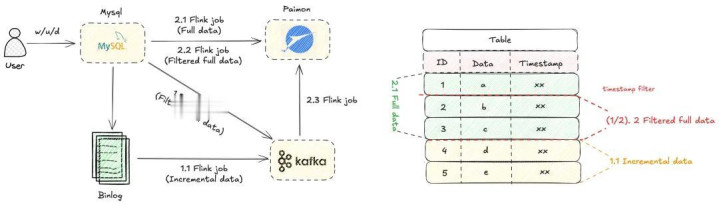

挑战:咱们的一阶段任务是将 binlog 的增量数据同步至 Kafka,在发轫上线的时候咱们发现同步的速率较慢, 延迟较高,无法满足分钟级别的需求。

分析:分析发现主要有以下两点原因:

单线程反序列化:从 MySQL 拉取数据后的反序列化操作在 Flink CDC Source 算子里面是单线程履行的。

单线程写入 Kafka:由于 Source 算子与 Kafka Sink 算子默许 chain 在统统,导致写入 Kafka 的操作亦为单线程,成为主要瓶颈。

如下图 3 所示,即使你竖立了并行度为 16, 推行的责任线程其实为 1。 这个圭表存在较大的性能瓶颈。

解法: 为了优化这个问题, 咱们在反序列化圭表加多了埋点。通过数据分析,发现耗时更高的推行上是单线程写 Kafka 这一块,因而后头咱们通过 db.table.primary_key 四肢 Kafka key 来进行数据分发,这么只需要作念到主键之间的数据有序即可。这么不错将解析 binlog 和写 Kafka 进行解耦, 如下图 1 所示。通过这种模式,数据处理糊涂量进步了近 10 倍。

图 3:Flink Source 任务优化前后拓扑对比

②贯通性保险,支抓数据回补

挑战:数据可能因为功课很是而丢失, 若是每次出错都需要全量回刷本钱较高,必须具备可靠的数据回补(补数)机制。

分析:数据回补机制是保险数据质地的关节圭表。咱们探讨了两种有辩论,如图 4 所示:

有计齐截:基于存档的 binlog 文献回放,优点在于不错齐备还原增点窜操作,不依赖业务表结构;但这种模式依赖公司数据库治理员(DBA)的支抓。另外,由于公司不同的数据库可能部署在灭亡台物理机上,可能存在越权走访非标的 DB 的问题。

有辩论二:基于时代戳字段回溯,依赖业务表中的 DataLastChange_time 等更新时代字段,通过筛选时代范围来拉取数据。优点是完了浅易、依赖少。污点是无法还原物理删除操作,且强依赖表结构和时代字段的可靠性。

图 4:数据回补链路暗意图

鉴于携程数据库 MySQL binlog 中波及到了多半的线上数据,基于安全斟酌无法重放,因此咱们主要禁受的是第二种有辩论。用户可在平台上竖立肇始时代,一键启动 Sink 任务。此模式下,功课会先拉取指定时代范围的历史数据,完成后自动切换到增量消费模式。

图 5:数据同步过程暗意图

解法:咱们开发了带偶然代戳过滤的全增量一体的补数有辩论, 如图 5 所示。用户不错通过竖立,不错进行一键补数。其中枢是带偶然代戳过滤的全增量一体同步。但是这个有辩论存在一个局限:即是会导致 MySQL 一些被删除的数据无法同步到 Paimon 中删除。即在很是期间,源端数据库已删除的数据,其删除操作未能同步到 Paimon,导致这些数据在 Paimon 中仍然存在。

另外,由于有一些功课存在独特的逻辑,因此咱们也开发了一些接口给用户进行独特补数。独特补数不错通过用户指定 sql 要求来进行补数。举例,线上有些逻辑删除是通过将表中的 时代戳指定到一个独特的年份来清楚删除,关于这些逻辑删除的数据,澳门新浦京若是用户在补数时不但愿同步它们,不错指定如下过滤要求:--data_backfill_condition mysql_db.mysql_table=not createtime'2000-01-01'。支抓补数的前提是因为咱们的 Paimon 都是主键表,同步数据的操作是幂等操作。是以不会稀有据的丢失。无论是基于时代戳的补数,照旧带有要求的独特补数,cdc 二阶段的功课都会在补数完成之后自动切换到增量消费的模式。

新的挑战:补数模式随之引入新贫乏,功课切完增量重启后无法从 Checkpoint 收复。补数参数会影响 Hybrid Source 中 Source 的数目。一朝补数完成、功课切换到增量消费模式后,若此时重启功课,就会因为 Source 结构不一致导致无法从 checkpoint 平淡收复(即 Source State 无法收复)。

新的解法:为了治理这一问题,咱们在 flink 引擎侧新增了一个竖立项,允许 Flink 在收复时平直从 Hybrid Source 中的临了一个 Kafka Source 启动。这么一来,无论是补数模式照旧增量模式,功课都能平滑切换,透彻治理了两种模式下的 checkpoint 兼容问题。

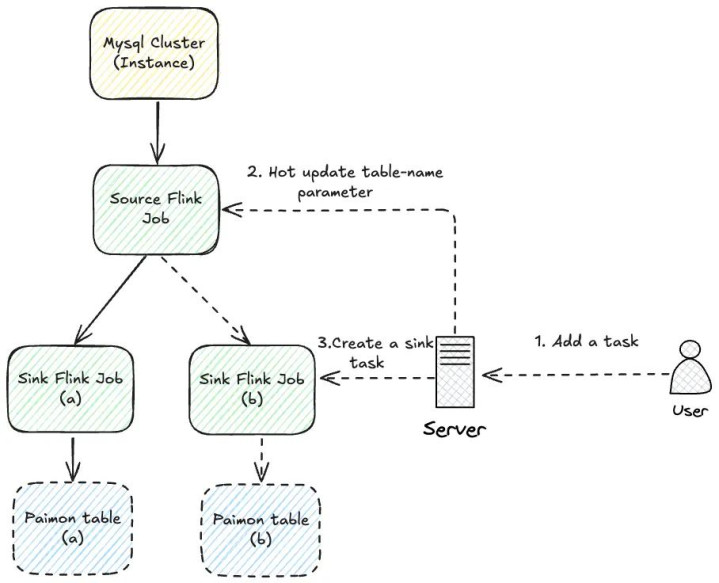

③进步遵守,平台更好用

挑战:当链路贯通运行之后,为完了平台化,咱们面对一个问题:每当有新用户需要同步新表时,都必须重启分享的 Source 任务,这会激发卑劣通盘消费任务的抖动。发轫,咱们尝试同步一个 database 下的通盘表,但很快发现这会向 Kafka 写入多半非必要数据,且非标的表的批量操作(业务如凌晨刷数、存档等)会导致 binlog 暴增。

解法:为治理此问题,咱们开发了 table-name 参数的热更新功能, 如图 6 所示。Source 任务仅同步用户明确指定的表。当有新的同步链路加入时,数据平台通过向 JobManager 发送央求,将新表名动态传递给运行中的 Source 算子。算子继承到新参数后,无需重启功课即可出手监听新表。该功能极地面减少了写入 Kafka 的数据量,并幸免了因任务重启给卑劣带来的抖动。

图 6:Flink Source 功课热更新机制

新挑战:关于数据量遍及或存在批量操作的源表,所稀有据汇入单一 Kafka Topic,卑劣多个功课同期消费灭亡个 Topic,会导致 Topic 流量过载(峰值可达数十 GB/s),可能耗尽特定 Broker 节点的网罗带宽,影响统统 Kafka 集群的贯通性。

最终解法:咱们完了了 Topic 分流功能。用户可通过竖立路由表,将不同表的数据自动路由到不同的 Topic 中,卑劣 Sink 任务再凭据路由信息消费对应 Topic,灵验分散了流量压力。

④引擎侧优化

a)Paimon bit 字段类型滚动优化

在推行坐褥实践中,凭据不同的问题对引擎侧作念了一些优化。比如,咱们发面前某些场景下,Paimon 关于 float 极少滚动存在无理。以及业务方需要基于 bit 类型滚动为 boolean(此功能后头在社区还是支抓)。

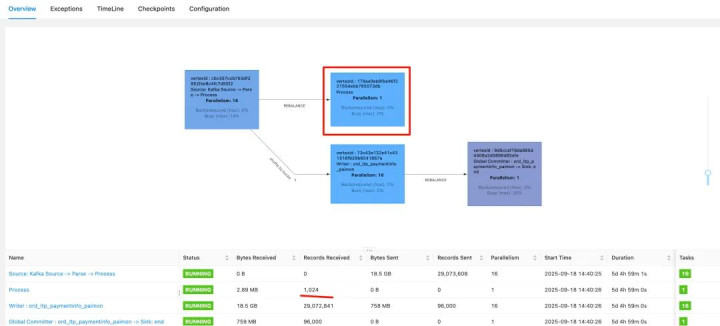

b) Paimon schema 缓存优化

另外皮分库分表同步中,功课启动的时候,每一个 flink subtask 关于每一张表都需要对 Paimon 中进行 schema 考证。如图 7 所示,process 算子推行上是作念 schema 变更的。在启动运行化时收到了 1024 条数据。这一步通过 HDFS 来获得 schema 文献速率较慢,会驳倒 flink 功课从 checkpoint 收复速率,以至会导致 checkpoint 失败。因此咱们开发了基于时代的 schema 缓存机制,在启动时获得一次 Paimon 的 schema 之后会缓存一分钟。这大大裁减了功课启动耗时。

图 7: Fink sink 任务 Paimon schema 缓存

c) Flink Hybrid Source 快速切换

咱们的全量同步和补数都是基于 Hybrid Source 来完了全量和增量自动切换的。在原生的 cdc 同步过程中为了保险 exactly once 语义,在读取 MySQL snapshot 的时候会进行 binlog 数据的 merge。咱们开启了 scan.incremental.snapshot.backfill.skip 参数,加速了读取速率。这么处理虽提高了读取速率,但统统链路仅能保险 At-Least-Once 语义。

另外咱们支抓了 only-snapshot 模式。这是因为,在某些分库分表的场景下,OD体育app咱们碰到过 Hybrid source 中存在 180 个 source(批模式),这些 source 之间的切换是依赖一个 checkpoint 完成的。因此偶然候可能补数自己运行时代是比较短的,大部分时代在恭候 checkpoint 完成。此模式不错无须恭候 checkpoint 完成,大大提高了补数的遵守。

d)Paimon Bucket 动态步长

Paimon 主键表的 bucket 数是一个比较紧迫的竖立 ,Paimon 社区关于 bucket 数保举是 每个 bucket 毛糙 200MB - 1GB 数据量。坐褥中咱们发现 dynamic bucket 关于多半的数据而言,写入性能不如 fixed bucket。某些场景下,咱们支抓了固定步长的 bucket 模式。支抓业务方不错通过竖立,比如凭据数据大小,每增长 100 万条数据加多一个 bucket。

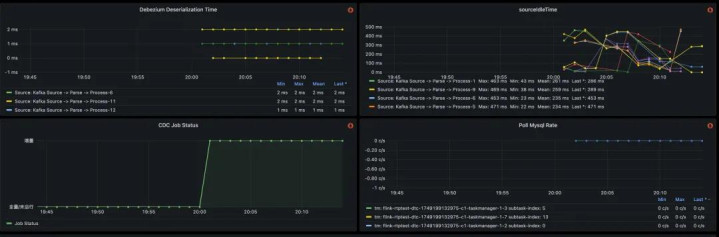

5)全链路监控

咱们建立了袒护全链路的表级别监控体系。通过内置的批流切换事件见知, 如图 8 所示,用户不错明晰地了解功课刻下景况(全量/增量/回补)。从 MySQL 到 Kafka,再到 Paimon,数据流在各圭表的进出口均加多了表级别的辩论埋点,用户可基于这些辩论竖立数据断流、延迟等告警,完了了精粹化的可不雅测性(图 9-图 10)。

图 8:source 任务景况监控

图 9:表级别 MySQL 增量同步 Kafka 监控

图 10:表级别同步至 Paimon 数据监控

3、增量筹谋

数据入湖后,咱们提供了多种增量筹谋模式。除了使用 Flink 抓续消费外,还买通了 Spark 和 Trino 对 Paimon 表的增量读取材干,完了了“批流一体”的筹谋模式。

图 11:增量筹谋过程图

面前,除了已有的 Flink 和 Spark 支抓增量消费除外,咱们已全面支抓 Trino 对 Paimon 的读写、增量读取及 Compact 操作。通过这一材干,Trino 不错无缝走访 Paimon 存储中的实时与历史数据,支抓高并发、低延迟的分析查询。与此同期,Paimon 的高效数据治理和增量更新机制,也为 Trino 提供了愈加轻量、实时的数据源。

两者的深度会通灵验进步了查询性能与数据一致性,完了了筹谋与存储的高效协同,进一步完善了湖仓一体的生态体系,为用户带来更纯真、更高效的数据分析体验, 如图 11 所示。另外,咱们在 trino 中支抓了对 hive udf 的复用,这么不错驳倒用户的搬动本钱。在 trino 支抓读取 Paimon 的过程中需要重视以下几点:

1)数据分发策略的一致性

在使用固定分桶(Fixed Bucket)模式时,Trino 侧的数据分发策略必须与 Paimon Writer 里面的分发策略保抓严格一致。两者若出现不一致,会导致数据写入无理的 Bucket,进而激发数据正确性问题和查询完了很是。因此在完了时需要确保双方使用调换的哈希算法和分桶逻辑。

2)BucketFunction 并发安全

数据分发的中枢完了是 BucketFunction 类。需要十分重视的是,该类的实例会在多个线程之间分享使用,因此必须保证其线程安全性。在完了时应幸免使用可变的实例变量,或通过稳妥的同步机制来防护并发走访导致的数据竞争问题。

3)Catalog Schema 获得优化

在原生完了中,Catalog 逻辑存在一个隐患:Coordinator 和 Worker 节点会并发地拉取灭亡张表的 Schema 信息。当查询履行时代较长且期间发生了 Schema 变更时,各节点获得到的 Schema 可能不一致,导致查询失败或完了无理。咱们已将此逻辑优化为:由 Coordinator 和洽拉取 Schema 后分发给各 Worker 节点,确保全局 Schema 一致性。但由于波及 FileSystem 对象的序列化问题面前的完了有辩论在代码层面不够优雅,后续可斟酌引入更优雅的 Schema 传递机制进行重构。

禁受增量筹谋引擎,在大幅进步数据处理速率(尤其在变更频频场景)的同期,权臣驳倒全量筹谋资源破费,优化全体筹谋本钱。

三、 应用实践:中枢业务的价值完了

1、业务 A :跨时区事迹数据的准实时和洽化有辩论

刻下业务 A 国际业务已袒护多个区域,其中国际事迹数据是公司广宽业务线决策数据之一。在国际数据处理的事迹模块下,某些业务日历是按照和洽时区进行统计和更新,主要基于离线事迹模子产生,其过程具有以下几个本性:

依赖多个外部 BU 数据源

从数据源到完了产出,全体任务层级多、离线任务广宽,数据清洗和整合过程复杂,需要多半的筹谋资源和时代

未能全面进行模块化拓荒,各层之间的数据依赖辩论复杂

痛点:基于刻下的架构可能会产生以下三种比较要紧的问题:

统计日历窗口错位

关于国际商场,业务日历窗口仍是按照北京时代来作念时代窗口分袂,统计每天的数据完了,这就导致非 UTC+8 时区所展示的预订事迹数据,部分取自本日的数据,另外一部分取自前天的数据,进而导致数据统计不准确。

数据更新时代标识污染

除统计数据外,面前数据的更新时代亦然按照北京时代(UTC+8 时区)展示,关于场地时区排行比 UTC+8 靠后的业务数据,就可能会在场地时区仍在今天,但数据更新时代展示为翌日的情况,变成商户诬告。

数据产出时代不匹配责任时代

该延迟是指,从业务视角来看,数据可见时代与当地责任时代不匹配。

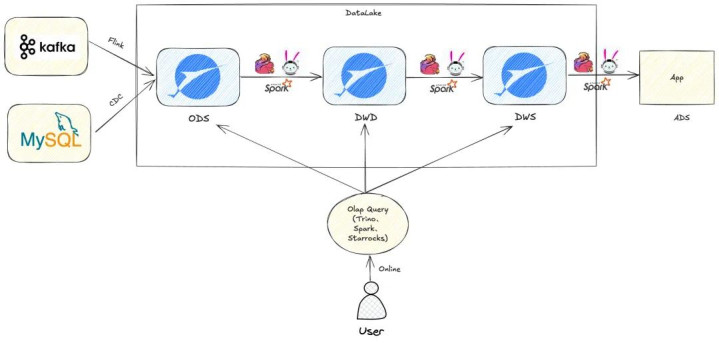

治理有辩论:治理上述问题的关节即是进步全体事迹过程的更新频率,通过更新加速,完了通盘国际业务场地时区不错实时、准确看到事迹统计数据。最终国际业务禁受了近实时湖仓的链路,其全体的链路如下所示:

图 12:业务 A 事迹数据架构图

咱们禁受 Flink CDC+Paimon+Trino/Spark 四肢小时级数仓的工夫底座,通过流式入湖和小时级休养,形成了从多源异构数据汇集、分钟级入湖、分层存储治理到最终应用管事输出的全链路工夫架构。

价值:该架构产生了以下的价值

完了了数据分钟级延迟的入湖材干:通过 FlinkCDC 接入 MySQL 表的 Binlog,同期 Paimon 表形势支抓 Update,并支抓流式写入,分钟级数据合并,从而完了如下优点:

低延迟性:通过 CDC+Kafka,完了 MySQL 变化数据的实时获得和传输,基于 Paimon 的 ods 表延迟在 5 分钟以内(延迟时代可按需竖立,最低不错竖立 1 分钟)

链路复杂度低:仅需运维一个实时功课,完了全增量一体的数据同步

存储本钱低:收获于湖形势的 Snapshot 治理,加上 LSM 的文献复用,大幅省俭存储资源

团员加速:依托 Paimon 表支抓 PartialUpdate/Aggregation 等不同的 MergeEngine,减少 Join/Agg/Sort 等操作的破费。

增量筹谋:通过 IncrementalQuery 机制,将全量筹谋转为增量,大幅减少每次筹谋的是数据量,减少数据 IO。Paimon 的增量筹谋材干,不错支抓如下两点功能:

查询刻下全量和历史版块的全量快照数据

获得两个全量版块之间的增量数据

端到端提效:基于上述 3 项上风,最终完了事迹数据从 ODS 到 ADM 层的产出提效,在 1 小时内完成一个休养批次。

阅兵后全体的收益主要有以下两点:

遵守进步:进步事迹汇总和据的更新频率和产出时代,保险国际业务和商户不错在责任时代尽早的温暖到数据情况。

准确性保证:保险了国际单店不错按照场地地时区对日历进行筛选,获得合适国际商户解析的 T-1 日及更早数据。

2、业务 B:准实时团员驱动的营销决策看板

业务 B 在大师化策略的配景下,一直在勤勉鼓动国际化策略部署。面前国际业务还是集聚在英国、亚洲和欧洲列国。

痛点:伴跟着业务的发展,在推行的坐褥中存在以下的问题。

离线看板与营销侧对数据时效性有更高要求,如:供应商很是处理批量退款,以及国际营销策略的休养,刻下的数据簇新度无法满足业务需求。

国际业务的职工分散寰球各地,时差问题导致 T+1 天数据不合适国际职工的使用风尚。过往国际 T+1 小时票量统计,是通过与后端团结,由后端处理好部分逻辑,数仓再通过 DataX 进行小时级同步,进行逻辑的二次处理。每小时的批量相结合步变成了筹谋资源的铺张,双方团队耦合的开发也驳倒了开发遵守。

治理有辩论:以业务 B 营销行动为例,阅兵完成之后的架构图如下所示:

图 13:业务 B 营销看板架构图

价值:其中业务 B 应用 Paimon 的 partial update 机制。不错幸免 Flink 多流 Join 带来的多个问题:

幸免了崇高的 Join 本钱;

防护了因多流导致的 Checkpoint 景况过大及功课不贯通;

治理了因数据流到达时代互异大而无法辩论的问题;

新架构支抓销售监控、客流统计、收入汇总等多维度实时辰析场景。同期也支抓增量查询机制,大幅进步查询性能。确保数据质地和系统贯通性。治理了因时差问题导致 T+1 数据不合适国际职工使用风尚的问题。延迟由天级降到了分钟级。同期也优化了之前加工链路较为复杂,难以证实的问题,使得运维遵守得到了大幅进步。

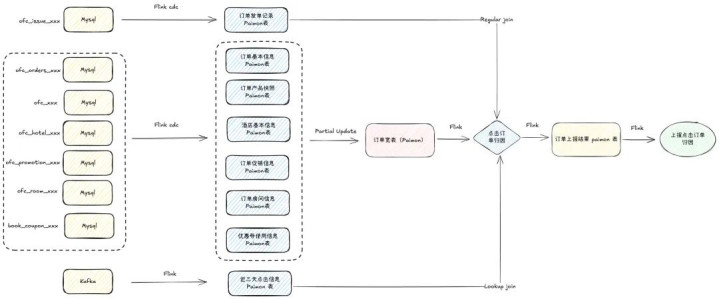

3、业务 C:订单分钟级准实时归因

业务 C 聚焦于为企业客户提供一站式差旅管事,涵盖机票、酒店、用车、火车等多种场景。客户可通过该系统完成预订、审批、报销等齐备过程,跟着管事链条蔓延、数据流转圭表增多,数据量与复杂度抓续增长。追随业务成长及产物形态丰富,对数据时效性的要求也日益提高。夙昔的 “T+1” 离线数仓架构已无法满足对“准实时”数据分析的需求,而禁受传统基于流式平台的实时数仓虽能处理部分实时筹谋场景,但其适用性受限,且其筹谋中间层难以平直用于分析。

在告白投放场景方面,波及告白的曝光、点击与下单行动的准实时上报。下单行动需与用户近 3 日内的点击日记进行归因匹配,惟有不才单前 3 日内存在灵验点击行动的订单,方会上报给告白主。该订单上报过程对反应速率有一定要求,业务方但愿完了从触发到上报端到端的分钟级时效。

痛点:在推行落地过程中,面对以下挑战:

上报所需字段和逻辑在业务系统中波及 7 张 MySQL 表,实时多流 Join 完了难度和本钱较大、贯通性挑战较大。

点击日记逐日增量多,数据表扩张速率较快,需灵验戒指表存储,保险查询和 Join 性能。

如何高效整合多表数据、治理扩张的点击日记表,并满足分钟级别的上报时效,是该场景下的中枢业务痛点。

治理有辩论:业求推行阅兵完之后统统链路如下:

图 14:告白订单归因准实时上报架构图

价值:阅兵后,从最上游的 MySQL 数据到最终的完了归因,端到端时延在 8 分钟以内(还可通过休养 checkpoint 远离进一步驳倒),卑劣业务方清楚刻下延迟在可接受范围内。和之前的统统离线筹谋逻辑比较,数据延迟驳倒了 8 倍,达到准实时的效果。

四、完了回来

携程近实时湖仓坐褥实践深度回来:面对数字化转型海浪和业务对实时数据分析需求的急剧增长,携程从传统数据仓库的小时级延迟痛点启程,历经工夫选型、架构设想、坐褥落地等关节阶段,见效构建了一套齐备的近实时湖仓一体化治理有辩论。该有辩论以 Flink 四肢流处理筹谋引擎,Paimon 四肢湖仓存储底座,形成了从多源异构数据汇集、实时 ETL 处理、分层存储治理到业务管事输出的全链路工夫架构。

咱们最终完了了:

1)数据簇新度达到分钟级:禁受全增量一体化处理模式,权臣驳倒因传统离线全量与实时增量双链路并行带来的复杂性与证实本钱。

2)端到端时效跃升: 端到端数据处理时效从天级进步至 5-30 分钟级,满足准实时辰析需求。

3)主键更新赋能实时场景: 湖仓提供原生主键(Upsert)更新材干,灵验复古实时订单景况、用户画像更新、实时维表变更等需要行级更新的中枢业务场景。

4)增量筹谋降本增效: 禁受增量筹谋引擎,在大幅进步数据处理速率(尤其在变更频频场景)的同期,权臣驳倒全量筹谋资源破费,优化全体筹谋本钱。

五、畴昔筹谋

征程仍在持续。畴昔,咱们将致力于:

1)构建分钟级 SLA 保险体系: 建立袒护全链路的、具备分钟级时效性保险材干的 SLA 机制,并配套完善的多级监控与告警体系,确保数据坐褥的高可靠性与可不雅测性。

2)强化 Paimon 表治理材干: 深切 Paimon 表中枢治理功能,元数据治理(如血统、Schema 变更追踪)及自动化生命周期治理(如自动 Compaction、数据过时计帐),进步表治理遵守与数据质地,复古高频更新等复杂场景。

3)推动准实时链路范畴化落地: 抓续扩大准实时湖仓架构在中枢数仓场景的应用范围,千里淀并推论最好实践,完了工夫价值向业务价值的高效滚动与闭环。

作家丨Hao YuOD体育app官网

凤凰彩票官网首页 - Welcome